L'uso emergente dell'intelligenza artificiale (AI) negli istituti di previdenza sociale sta abilitando servizi di sicurezza sociale più proattivi e automatizzati. Tuttavia, anche l'applicazione dell'IA nella sicurezza sociale è impegnativa e le istituzioni stanno definendo come possono concretamente trarre il massimo vantaggio da questa nuova tecnologia. Questo articolo introduce all'intelligenza artificiale e descrive alcune esperienze applicative nella sicurezza sociale basate sulle discussioni tenute nel Webinar della rete europea ISSA: Intelligenza artificiale per le istituzioni di sicurezza sociale così come su altro materiale.

Background sull'intelligenza artificiale: miti, realtà e rischi

Nel 1950, Alan Turing nel suo saggio rivoluzionario pose la semplice domanda "Le macchine possono pensare?" Se una macchina può pensare, può comportarsi in modo intelligente e forse un giorno anche superare l'intelligenza dei creatori umani. Questa idea di "superintelligenza" è stata una potenziale fonte di ispirazione per molte storie di fantascienza.

Perché e perché no, AI?

Esiste un concorso internazionale - The Loebner Prize - che ogni anno assegna premi a programmi per computer che sono più simili agli umani. Ad oggi, non c'è stato un vincitore che abbia davvero superato il test e gli scienziati sono lontani dal progettare la superintelligenza artificiale. In realtà, potrebbero essere necessari decenni per raggiungere la capacità di manifestare la capacità di costruire un'intelligenza generale artificiale (AGI), che si riferisce all'IA che è simile all'uomo. Gli approcci attuali possono essere generalmente definiti come "IA ristretta" - sistemi che sono intelligenti non perché riescano a imitare l'intelligenza umana ma perché possono svolgere compiti che altrimenti richiederebbero intelligenza, tempo e impegno umani in misura insostenibile. Questi algoritmi di intelligenza artificiale stanno gradualmente sostituendo e completando gli algoritmi tradizionali che hanno risolto i problemi attraverso i computer.

I processi algoritmici dell'IA sono diversi da quelli tradizionali e possono essere più efficienti per molte attività. Nel caso dell'IA, invece di scrivere un programma per ogni specifica attività, vengono raccolti molti esempi che specificano l'output corretto (o errato) di un dato input. Gli algoritmi di intelligenza artificiale prendono quindi questi esempi e producono un programma che fa il lavoro. Il programma dovrebbe essere scalabile per nuovi casi. Se i dati cambiano, anche il programma può cambiare addestrandosi sui nuovi dati. Sono ora disponibili enormi quantità di potenza di calcolo per queste attività ed è per questo che è più economico che scrivere un programma specifico per l'attività.

Questa capacità di scalabilità e di sfruttamento delle intuizioni dai dati ha reso l'AI uno strumento essenziale e complementare per i responsabili politici e i fornitori di servizi che mirano al raggiungimento del bene sociale. Vari strumenti di intelligenza artificiale vengono utilizzati per la risposta alle crisi, l'empowerment economico, alleviare le sfide educative, mitigare le sfide ambientali, garantire l'uguaglianza e l'inclusione, promuovere la salute, ridurre la fame, verifica e convalida delle informazioni, gestione delle infrastrutture, gestione del settore pubblico e sociale e persino sicurezza e giustizia.

La natura multidisciplinare dell'IA

Mentre attualmente l'IA può essere definita "IA stretta", l'approccio degli algoritmi di IA è quello di imitare il processo del pensiero umano. Ciò include la modellazione del modo in cui gli esseri umani pensano e agiscono effettivamente. La progettazione di algoritmi di intelligenza artificiale richiede la comprensione del ragionamento umano, di cosa fanno gli esseri umani e di come agiscono. Ciò include anche la modellazione di come un essere umano ideale dovrebbe pensare e agire. Questi aspetti vengono compresi attraverso la conoscenza del ragionamento razionale ed etico. L'IA moderna si concentra sulla creazione di un'IA che sappia come "dovrebbe agire". Il successo di questi algoritmi è giudicato dalle misurazioni delle prestazioni adattate dai campi della statistica, della fisica, della matematica, della filosofia, dell'economia, delle scienze sociali, delle neuroscienze e delle scienze cognitive. Questo è il motivo per cui la creazione di un algoritmo AI funzionante richiede un approccio interdisciplinare, che sta per emergere.

Sotto l'ombrello dell'IA ci sono una serie di discipline. Queste discipline pongono domande come: i computer possono parlare? riconoscere la parola? capire il discorso? imparare e adattarsi? vedere? pianificare e prendere decisioni? E per rispondere a queste domande sono emerse e si sono evolute una serie di suddivisioni dell'IA: elaborazione del linguaggio naturale, visione artificiale, apprendimento automatico, data mining e molte altre. Negli ultimi anni si è assistito a un'ondata di nuovi metodi e tecniche come le reti neurali convoluzionali che promettono prestazioni elevate e divorano enormi quantità di dati. Questi algoritmi, in generale, seguono una pipeline che inizia con l'acquisizione dei dati e quindi segue una serie di passaggi: pulizia dei dati, archiviazione e gestione, selezione delle caratteristiche e discussione dei dati, analisi visiva, processo iterativo di modellazione, misurazione delle prestazioni, monitoraggio e alla fine producendo un output. Durante questi processi, i dati utilizzati sono suddivisi in diverse parti per addestrare, convalidare e testare le prestazioni dei modelli sulla base dei dati disponibili. Questo processo è in qualche modo simile al modo in cui gli esseri umani elaborano i dati.

Rischi

Poiché gli algoritmi di intelligenza artificiale attraversano sottoprocessi, ci sono una serie di aree a cui prestare attenzione. Una di queste cose è l'overfitting. A volte, gli algoritmi progettati si adattano così bene al set di dati di addestramento che non riescono a fornire la giusta soluzione nel mondo reale. Oltre a queste considerazioni, i dati, gli algoritmi e l'interazione umana in un algoritmo possono essere potenziali fonti di bias che possono essere una ragione per il fallimento dell'IA. Un'enorme quantità di dati viene immessa nella macchina per riconoscere determinati schemi. I dati non strutturati provenienti dal web, dai social media, dai dispositivi mobili, dai sensori, dai dispositivi intelligenti (cioè Internet of Things) rendono difficile l'assorbimento, il collegamento, l'ordinamento e la manipolazione dei dati. Se i dati non sono attentamente curati, il set di dati potrebbe essere pieno di dati incompleti o mancanti o potrebbe essere impreciso o parziale. Ciò può anche causare una rivelazione involontaria di dati sensibili a meno che non si prenda cura di rimuovere i dati personali da tutti i set di dati.

I sistemi di intelligenza artificiale sono soggetti a pregiudizi algoritmici. Alcuni algoritmi sono sistematicamente polarizzati verso un tipo specifico di dati. A parte questo, il bias dipende in gran parte dagli ingegneri che progettano gli algoritmi, da come questi vengono implementati e da come vengono utilizzati alla fine. Molto dipende da come viene inquadrato un problema. Mentre definiscono un problema, gli scienziati decidono cosa vogliono effettivamente ottenere quando creano un modello di apprendimento. Un algoritmo progettato per determinare il "merito creditizio" programmato per massimizzare il profitto invece di massimizzare il numero di prestiti potrebbe alla fine, ma involontariamente, decidere di concedere prestiti subprime predatori. Anche la composizione degli ingegneri può essere parziale. L'inquadramento di un problema dipende da chi lo progetta, da chi decide come viene distribuito, da chi decide il livello di accuratezza accettabile e da chi decide se le applicazioni dell'IA sono etiche. Il fallimento nell'affrontare questi problemi ha proliferato gli algoritmi che determinano quali annunci politici vedono le persone, come i reclutatori selezionano le persone in cerca di lavoro e persino come gli agenti di sicurezza vengono impiegati nei quartieri.

Verso un uso etico dell'AI

Sebbene l'IA come scienza risale a molto tempo fa, l'uso dell'IA nel mondo tecnologico è relativamente nuovo, e quindi molti leader di mercato sono in ritardo nello sviluppo dell'intuizione e della conoscenza pratica sui rischi sociali e organizzativi individuali. Alcuni tendono a trascurare i pericoli e altri sovrastimano le capacità di mitigazione del rischio. Inoltre, non c'è molto consenso tra i dirigenti riguardo a quali rischi anticipare. Molte aziende sostengono di aver preso precauzioni: stanno raccogliendo dati di formazione più ripetitivi, controllando e verificando regolarmente la presenza di pregiudizi involontari e conducendo analisi di impatto su determinati gruppi. Tuttavia, molti ricercatori di etica dell'IA sostengono che gli algoritmi di intelligenza artificiale sono addestrati su vecchi dati. Un algoritmo che funziona correttamente su un vecchio set di dati potrebbe non risultare in un sistema che funzionerà correttamente nella realtà. L'etica nell'intelligenza artificiale è quindi diventata un argomento di ricerca chiave.

Esperienze applicative in ambito previdenziale

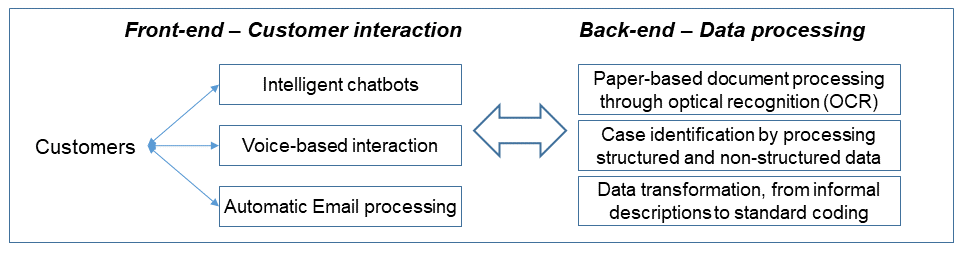

C'è una tendenza crescente nella sicurezza sociale ad applicare l'IA, in particolare per migliorare i servizi ai clienti attraverso il supporto front-end automatizzato 24 ore su 7, 1 giorni su XNUMX e anche, più incipientemente, automatizzando i processi di back-end (Figura XNUMX).

Diverse istituzioni di sicurezza sociale hanno implementato chatbot intelligenti per migliorare i servizi clienti online attraverso una disponibilità 24 ore su 7, 24 giorni su 7 di qualità in diversi rami e tipi di vantaggi. I chatbot intelligenti possono simulare il comportamento umano e sono in grado di rispondere in modo autonomo alle richieste degli utenti. Sono disponibili XNUMX ore su XNUMX, XNUMX giorni su XNUMX e possono adattarsi alle preferenze degli utenti.

La Soprintendenza per i rischi professionali (Sovrintendenza per i rischi professionali - SRT) dell'Argentina ha implementato un chatbot intelligente chiamato "Julieta" per rispondere alle domande sui benefici per gli infortuni sul lavoro. Il chatbot ha soddisfatto gli obiettivi di fornire servizi ai clienti automatizzati e personalizzati rispondendo non solo alle domande più frequenti, ma anche informandosi sullo stato delle operazioni dei clienti come l'iscrizione e le richieste di vantaggi. Alcuni dei fattori chiave identificati includono lo sviluppo di una base di conoscenza di qualità e la formazione permanente del chatbot che coinvolge un team multidisciplinare.

A sua volta, il chatbot intelligente implementato dalla Norwegian Labour and Welfare Administration (NAV) ha permesso di rispondere a una crescente domanda di informazioni nel contesto della crisi COVID-19. In concreto, durante il periodo da marzo a maggio 2020, il chatbot ha risposto a più di 8,000 richieste giornaliere, rispetto a un numero pre-COVID di 2,000. I fattori chiave di successo erano la formazione sul chatbot basata su una knowledge base aggiornata quotidianamente, l'attenzione su un tipo specifico di informazioni e una connessione continua dal chatbot a un esperto umano. Il chatbot viene esteso a nuovi argomenti, in particolare per supportare i datori di lavoro e i lavoratori autonomi.

In Uruguay, la Social Insurance Bank (Banca di previdenza sociale - BPS) ha implementato un chatbot intelligente per rispondere alle richieste dei datori di lavoro sullo schema per i lavoratori domestici. Applicando l'elaborazione del linguaggio naturale e le tecniche di gestione del dialogo, il chatbot comprende le intenzioni del cliente e suggerisce le azioni appropriate. Implementato nel gennaio 2019, il chatbot intelligente attualmente consente di rispondere al 97% di tutte le richieste, mentre il restante 3% coinvolge uno staff esperto. Il tempo di implementazione è stato di circa un anno, con sei mesi dedicati alla formazione e ai test. I fattori chiave di facilitazione identificati sono stati l'aggiornamento permanente della base di conoscenza, nonché lo sviluppo e il funzionamento attraverso un team multidisciplinare.

L'Organizzazione generale per la previdenza sociale (GOSI) dell'Arabia Saudita ha lanciato un uso sperimentale di chatbot intelligenti per l'erogazione dei servizi. L'obiettivo era sviluppare un agente intelligente per rispondere alle richieste dei clienti e per semplificare determinati servizi e transazioni. L'agente comunica con i clienti tramite diverse applicazioni di chat e social network.

Alcune istituzioni utilizzano l'intelligenza artificiale anche per migliorare i processi di back-end, in particolare per elaborare grandi volumi di dati comprendenti database tradizionali, testo e immagini non strutturati di documenti cartacei digitalizzati.

Employment and Social Development Canada (ESDC) ha applicato l'intelligenza artificiale per identificare i beneficiari del Supplemento al reddito garantito (GIS), un sussidio in denaro rivolto alle persone anziane a basso reddito. In due mesi, i modelli di Machine Learning hanno identificato oltre 2000 canadesi vulnerabili aventi diritto al GIS elaborando oltre 10 milioni di registrazioni di dati di testo non strutturati. Al fine di massimizzare la copertura dei beneficiari vulnerabili, gli esperti aziendali del programma GIS hanno deciso che il modello dovrebbe avere un alto grado di inclusione e falsi positivi intenzionalmente accettati che dovrebbero essere rivisti manualmente.

L'esperienza ha mostrato l'importanza di utilizzare dati rappresentativi e di catturare le sfumature, nonché di determinare le metriche e le soglie adeguate per le esigenze aziendali costruendo il set di dati di formazione insieme ad esperti aziendali. In base alle lezioni apprese, l'ESDC ha sottolineato che la qualità dei dati sottostanti è fondamentale e che i progetti di IA richiedono team multidisciplinari con data scientist ed esperti di business. I principali rischi identificati comprendevano la selezione di strumenti adeguati e le lacune di alfabetizzazione dei dati tra il personale dell'organizzazione.

L'istituto di previdenza sociale finlandese sta iniziando ad applicare l'IA in due modi: (i) migliorando i servizi ai clienti combinando servizi elettronici con chatbot intelligenti e (ii) utilizzando il riconoscimento delle immagini basato sull'intelligenza artificiale per automatizzare i processi amministrativi riconoscendo i documenti.

Allo stesso modo, il National Social Security Institute of Brazil (INSS) sta implementando un chatbot intelligente – chiamato Helô – per fornire risposte automatizzate 24 ore su 7, 2020 giorni su XNUMX alle richieste dei clienti nel contesto dei servizi elettronici personalizzati myINSS. Una prima versione distribuita a maggio XNUMX ha già elaborato circa un milione di richieste. L'INSS utilizza anche l'intelligenza artificiale per accelerare il rilevamento della morte del beneficiario, il che consente di prevenire pagamenti indebiti.

Allo stesso modo, il Fondo ausiliario per le indennità di disoccupazione del Belgio (Fondo ausiliario di pagamento dell'indennità di disoccupazione - CAPAC) ha svolto un'applicazione preliminare di AI per l'elaborazione di moduli cartacei tramite Optical Character Recognition (OCR), che tuttavia non ha portato a risultati soddisfacenti. Nonostante queste difficoltà, CAPAC mantiene le applicazioni AI all'ordine del giorno e prevede di sviluppare un chatbot intelligente.

A sua volta, l'assicurazione sociale austriaca (Organizzazione ombrello delle agenzie di assicurazione sociale austriache - SV) applica l'intelligenza artificiale per molteplici scopi. In primo luogo, implementare un chatbot intelligente - OSC Caro - che fornisce assistenza digitale ai clienti in varie aree come assegni per l'infanzia, indennità di malattia e rimborsi. Inoltre, un sistema di riconoscimento vocale supporta i servizi di call center inoltrando automaticamente le richieste dei clienti agli uffici corrispondenti. Il modello linguistico del sistema, basato sull'intelligenza artificiale, è stato addestrato per riconoscere termini specifici. Inoltre, l'intelligenza artificiale viene utilizzata anche per implementare l'invio automatico di e-mail ai dipartimenti corrispondenti con una precisione fino al 93%. Infine, un progetto in corso sta implementando un processo di rimborso semiautomatico basato sull'intelligenza artificiale delle tariffe dei servizi medici. In questo caso, l'AI viene applicata per automatizzare diverse attività come il riconoscimento dei documenti presentati, la codifica della diagnosi utilizzando lo standard ICD-10 e l'estrazione dei dati richiesti per il rimborso (es. Importo della fattura, IBAN). Questo trattamento semiautomatico consente di velocizzare il processo di rimborso oltre a supportare il personale coinvolto.

A livello governativo, diversi paesi stanno definendo strategie nazionali sull'intelligenza artificiale. In particolare, la strategia estone mira a consentire un governo proattivo basato su una progettazione di servizi per eventi della vita e fornire servizi personalizzati con zero burocrazia attraverso un'applicazione intensiva dell'IA.

La visione estone dei servizi pubblici digitali basati sull'intelligenza artificiale viene messa in pratica attraverso #KrattAI, una rete interoperabile di applicazioni di intelligenza artificiale che consente ai cittadini di utilizzare i servizi pubblici attraverso l'interazione vocale con assistenti virtuali. Gli oltre 70 progetti in corso nell'ambito di questa strategia, di cui 38 già operativi, coprono un'ampia gamma di settori, tra cui applicazioni ambientali, supporto di emergenza, sicurezza informatica e servizi sociali. In particolare, nel contesto dell'assicurazione contro la disoccupazione viene applicato un chatbot intelligente per i servizi ai clienti e l'elaborazione dei casi di rischio di disoccupazione a lungo termine.

Le lezioni apprese comprendono la garanzia della qualità e della privacy dei dati coinvolti, nonché la fornitura di metadati e la gestione della scalabilità delle applicazioni basate sull'intelligenza artificiale utilizzando l'infrastruttura cloud e lo sviluppo di modelli di approvvigionamento adeguati. Inoltre, i limiti dell'automazione per i servizi pubblici devono essere valutati correttamente.

Conclusioni e punti chiave

L'intelligenza artificiale sta gradualmente diventando una tecnologia chiave per le organizzazioni di sicurezza sociale in quanto consente di aumentare l'efficienza amministrativa automatizzando i processi e di assistere il personale nelle attività che richiedono decisioni umane.

Tuttavia, sebbene si possano osservare sviluppi positivi, sorgono anche diverse sfide. Questi si riferiscono in particolare ai limiti e ai rischi dell'intelligenza artificiale e al compromesso tra l'automazione dei processi e il controllo umano. Inoltre, le differenze metodologiche tra l'intelligenza artificiale e lo sviluppo di software tradizionale pongono sfide alle istituzioni che realizzano i progetti.

Tra i fattori critici, la disponibilità e la qualità dei dati sono evidenziate come un must per addestrare adeguatamente i sistemi di IA. Tali "esigenze di dati" richiedono la definizione di una strategia organizzativa per utilizzare i dati interni, nonché potenzialmente i dati di altre organizzazioni, e comporta anche la valutazione della conformità alle normative sulla protezione dei dati.

L'adozione dell'IA richiede capacità istituzionali specifiche. Le istituzioni devono avere una comprensione dettagliata dell'obiettivo del progetto, selezionare dati rappresentativi del mondo reale, scegliere soluzioni semplici, prestare particolare attenzione alla spiegabilità degli algoritmi utilizzati, scegliere modelli che non solo abbiano i migliori risultati ma che siano anche equi standard che devono essere progettati con cura e, infine, garantire la trasparenza per garantire la responsabilità.

Inoltre, le istituzioni che applicano l'IA hanno sottolineato l'importanza di avere progetti sviluppati da team multidisciplinari che coinvolgano personale aziendale e data scientist. In questa linea, anche l'alfabetizzazione del personale sull'intelligenza artificiale e la gestione dei dati diventa un fattore chiave. Gli imprenditori ei project manager devono comprendere le implicazioni dell'applicazione AI per definire quali processi potrebbero essere automatizzati e quali decisioni devono essere nelle mani dell'uomo.

L'ISSA esprime la sua gratitudine a Moinul Zaber, Senior Academic Fellow, Operating Unit on Policy-Driven Electronic Governance, United Nations University, per il suo contributo tecnico a questo articolo.

Riferimenti

- Webinar della rete europea ISSA: Intelligenza artificiale per le istituzioni di sicurezza sociale, 22 settembre 2020

- Webinar ISSA: miglioramento del servizio clienti tramite servizi online avanzati, 18 June 2020

- Webinar ISSA: miglioramento dell'efficienza e dei servizi ai clienti attraverso l'automazione dei processi avanzata, 17 June 2020

- Webinar ISSA: miglioramento dei canali digitali attraverso servizi elettronici avanzati, 4 June 2020